Nový urychlovací čip s názvem „Hiddenite“, který dokáže dosáhnout nejmodernějšího stavu techniky přesnost ve výpočtu řídkých „skrytých neuronových sítí“ s nižší výpočetní zátěží byl nyní vyvinut výzkumníky Tokyo Tech. Využitím navržené konstrukce modelu na čipu, která je kombinací generování hmotnosti a rozšíření „supermask“, čip Hiddenite drasticky snižuje přístup k externí paměti pro vyšší výpočetní efektivitu.

Hluboké neuronové sítě (DNN) jsou složitou součástí architektury strojového učení pro AI (umělé učení), která vyžaduje řadu parametrů, aby se naučila předpovídat výstupy. DNN však lze „ořezat“, čímž se sníží výpočetní zátěž a velikost modelu. Před několika lety vzala svět strojového učení útokem „hypotéza loterijního lístku“. Hypotéza uváděla, že náhodně inicializované DNN obsahuje podsítě, které po natrénování dosahují přesnosti ekvivalentní původní DNN. Čím větší síť, tím více „losů“ pro úspěšnou optimalizaci. Tyto losy tak umožňují „ořezaným“ řídkým neuronovým sítím dosáhnout přesnosti ekvivalentní složitějším „hustším“ sítím, čímž se sníží celková výpočetní zátěž a spotřeba energie.

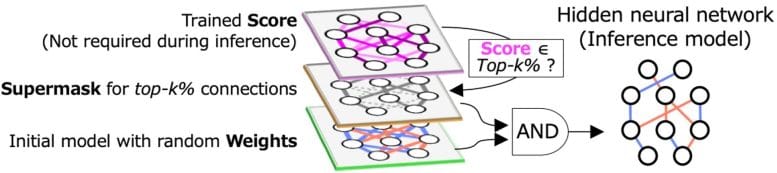

Obrázek 1. HNN nacházejí řídké podsítě, které dosahují stejné přesnosti jako původní hustý trénovaný model. Kredit: Masato Motomura z Tokyo Tech

Jednou z technik, jak najít takové podsítě, je algoritmus skryté neuronové sítě (HNN), který používá logiku AND (kde je výstup vysoký pouze tehdy, když jsou všechny vstupy vysoké) na inicializovaných náhodných vahách a „binární masce“ nazývané „supermaska“ (Obr. 1). Supermaska, definovaná nejvyššími k% nejvyššími skóre, označuje nevybraná a vybraná spojení jako 0 a 1, v tomto pořadí. HNN pomáhá snížit výpočetní efektivitu ze strany softwaru. Výpočet neuronových sítí však také vyžaduje vylepšení hardwarových komponent.

Tradiční DNN akcelerátory nabízejí vysoký výkon, ale neberou v úvahu spotřebu energie způsobenou přístupem k externí paměti. Nyní výzkumníci z Tokijského technologického institutu (Tokyo Tech), vedení profesory Jaehoon Yu a Masato Motomura, vyvinuli nový akcelerační čip nazvaný „Hiddenite“, který dokáže vypočítat skryté neuronové sítě s drasticky zlepšenou spotřebou energie. „Snížení přístupu k externí paměti je klíčem ke snížení spotřeby energie. V současné době vyžaduje dosažení vysoké přesnosti odvození velké modely. To však zvyšuje přístup k externí paměti k parametrům modelu zatížení. Naší hlavní motivací za vývojem Hiddenite bylo omezit tento přístup k externí paměti,“ vysvětluje prof. Motomura. Jejich studie se objeví v nadcházejícím Mezinárodní konference o polovodičových obvodech (ISSCC) 2022, prestižní mezinárodní konference představující vrcholné úspěchy v oblasti integrovaných obvodů.

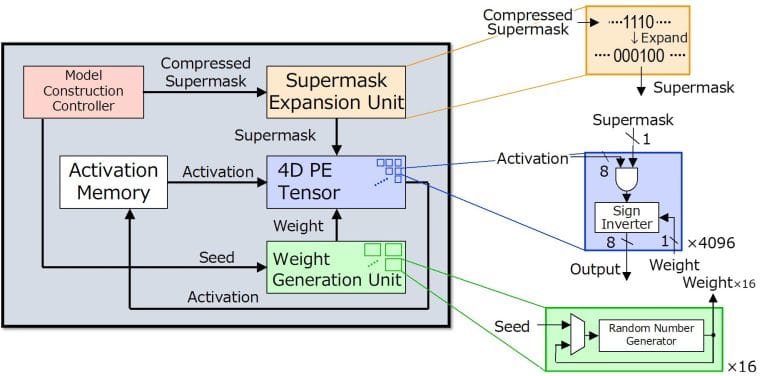

Obrázek 2. Nový čip Hiddenite nabízí generování hmotnosti na čipu a „rozšíření supermasky“ na čipu ke snížení přístupu k externí paměti pro načítání parametrů modelu. Kredit: Masato Motomura z Tokyo Tech

„Hiddenite“ je zkratka pro Hidden Neural Network Inference Tensor Engine a je prvním inferenčním čipem HNN. Architektura Hiddenite (obr. 2) nabízí trojí výhody pro snížení přístupu k externí paměti a dosažení vysoké energetické účinnosti. První je, že nabízí generování hmotnosti na čipu pro opětovné generování vah pomocí generátoru náhodných čísel. To eliminuje potřebu přístupu do externí paměti a ukládání závaží. Druhou výhodou je poskytnutí „rozšíření supermasky na čipu“, které snižuje počet supermasek, které musí akcelerátor načíst. Třetím vylepšením, které čip Hiddenite nabízí, je čtyřrozměrný (4D) paralelní procesor s vysokou hustotou, který maximalizuje opětovné využití dat během výpočetního procesu, a tím zvyšuje efektivitu.

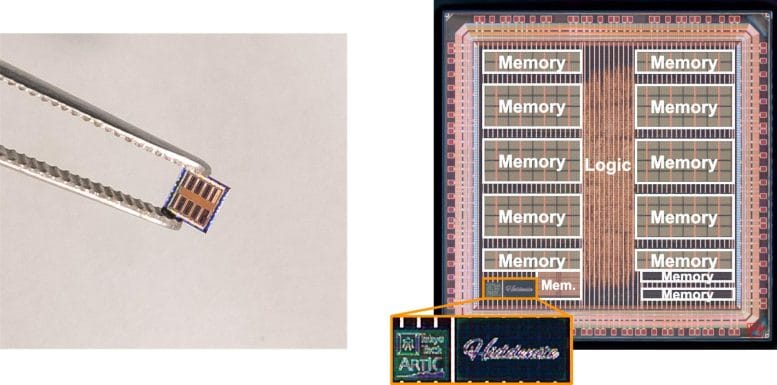

Obrázek 3. Vyrobeno pomocí 40nm technologie, jádro oblasti čipu má pouze 4.36 milimetrů čtverečních. Kredit: Masato Motomura z Tokyo Tech

„První dva faktory odlišují čip Hiddenite od existujících akcelerátorů inference DNN,“ prozrazuje prof. Motomura. „Navíc jsme také zavedli novou trénovací metodu pro skryté neuronové sítě, nazvanou ‚destilace skóre‘, ve které jsou konvenční váhy destilace znalostí destilovány do skóre, protože skryté neuronové sítě nikdy neaktualizují váhy. Přesnost pomocí destilace skóre je srovnatelná s binárním modelem a přitom je poloviční než u binárního modelu.

Na základě architektury hiddenite tým navrhl, vyrobil a změřil prototyp čipu pomocí 40nm procesu Taiwan Semiconductor Manufacturing Company (TSMC) (obr. 3). Čip má rozměry pouze 3 mm x 3 mm a zvládá 4,096 34.8 operací MAC (multiply-and-accumulate) najednou. Dosahuje nejmodernější úrovně výpočetní efektivity, až XNUMX bilionu nebo tera operací za sekundu (TOPS) na watt výkonu, a zároveň snižuje objem přenosu modelu na polovinu oproti binarizovaným sítím.

Tato zjištění a jejich úspěšná prezentace ve skutečném křemíkovém čipu jistě způsobí další změnu paradigmatu ve světě strojového učení a připraví cestu pro rychlejší, efektivnější a v konečném důsledku i ekologičtější výpočty.